« La priorité c'est de révéler tous les usages dont les clients nous parlent », indique Edouard Beaucourt, country manager France de Snowflake. (crédit : D.F.)

Loin d'ętre uniquement cantonné au datawerhouse cloud, la plateforme Snowflake monte en puissance sur les usages data sharing et data marketplace. Les ambitions de l'éditeur pour la France sont grandes, comme nous l'a indiqué Edouard Beaucourt, country manager France de l'éditeur lors du dernier salon Big Data Paris 2021.

Vous avez pris la direction de Snowflake en France il y a quelques mois : quelles ont été vos impressions sur cette création de poste et vos ambitions ?

Edouard Beaucourt. Il y avait déjŕ une représentation et des ressources déployées sur le terrain depuis quelques années. Cela a permis de constituer de premiers succčs avec un bon nombre de clients et de partenaires autour d'un écosystčme qui est déjŕ en place. Le premier sujet qui confirme mon appétence ŕ rejoindre et ŕ ętre avec Snowflake, c'est notre faculté ŕ couvrir déjŕ probablement 40 ŕ 50% du cycle de la vie de donnée chez nos clients. J'ai la sensation que notre roadmap et nos ambitions est d'ętre de plus en plus le partenaire unique de nos clients autour du sujet data cloud.

Quelle est votre base clients ?

Au global, 5 000 clients aux États-Unis, en Europe, en France... Avec un peu plus aux États-Unis qu'ailleurs.

Quelle est la place de la France dans votre positionnement international ?

La France compte parmi les pays les plus stratégiques pour l'Europe aux côtés de la Grande-Bretagne et l'Allemagne, et sur lequel on met en place un déploiement ŕ l'échelle pour adresser tous les sujets de notre filiale de distribution locale. Comme s'engager avec les clients, des partenaires de toute sorte, intégrateurs... Nous parlons beaucoup avec nos alliés technologiques et nous avons aussi mis en place les principes de data sharing et de data marketplace pour fabriquer un nouvel écosystčme et un nouveau réseau au travers de la donnée pour aider n'importe qui a créer des offres sur ces marketplaces.

Comment faites-vous évoluer votre réseau de partenaires ?

On adresse le marché de maničre universelle, des TPE jusqu'aux plus grands comptes du CAC40. Pour y parvenir, on ne le fait pas tout seul dans notre petit coin. Nous avons une vision de plateforme data qui tire parti d'alliances technologiques avec Dataiku, Talend, Service Now... On a déjŕ tout cet écosystčme d'alliances technologiques. Nous avons aussi besoin, comme nous sommes sur de gros projets de transformation, de parler avec des acteurs du conseil et de l'intégration de systčmes. Dans notre vision data cloud, il y a un 3e aspect essentiel de data sharing et la data marketplace.

Comment cela est appréhendé par les clients ?

Cela part d'un constat trčs simple. Snowflake est une plateforme de données, un systčme de traitement de la donnée sous format SQL natif cloud permettant d'adresser de nombreux cas d'usage.

Ce n'est pas datawarehouse ?

Non. Un datawarehouse par défaut est cantonné sur l'entreposage, le stockage et l'historisation de la donnée. Lŕ on a un systčme qui peut faire beaucoup de traitement, de transformation, d'ingestion... Snowflake n'a pas les męmes limites qu'un datawarehouse et va bien au-delŕ. Nous sommes les premiers ŕ permettre le partage de données sans dupliquer on s'est exposé les infos en mettant toute la gouvernance et la sécurité et le fait d'interagir avec leur écosystčme, des fournisseurs de données privés et des tiers de confiance avec un pilotage le plus affiné possible. Cette data marketplace va comprendre les éléments de monétisation de l'information, de la gestion de l'accčs, de la sécurité...

Comment cela fonctionne ?

La marketplace est le frontal qui permet d'accéder aux données clients et partenaires. On est capable de partager beaucoup plus que de la donnée, de la logique business, de documenter les données que l'on partage, fournir des requętes, on peut avoir du paiement ŕ l'usage ou par l'abonnement directement sur la plateforme. La marketplace repose sur des capacités natives de datasharing. Vu que la donnée est sur Snowflake elle est directement manipulable avec tous les bénéfices de scalabilité qui en découlent. En plus on est un écosystčme ouvert et accessible avec tous les standards du marché.

Quels sont vos partenaires technologiques et comment répondez-vous ŕ la problématique de localisation des données ?

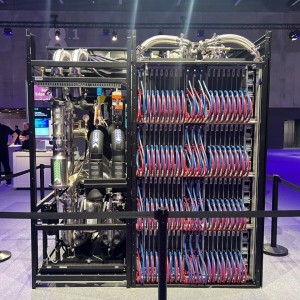

On utilise les briques banalisées des fournisseurs de cloud, du stockage objet sur S3 d'AWS ou du Cold Storage sur Azure ou encore GCP. Cela offre un rapport performance prix trčs intéressant. Et sur la partie compute on s'appuie sur les capacités des clouds providers. On n'utilise pas de co-processeurs spécifiques pour le calcul. La spécificité de Snowflake c'est que le client peut instancier autant de datawarehouse virtuels qu'il veut et instancier autant de puissance de calcul ŕ la fois pour gérer et calculer les données.

Le client peut-il gérer lui-męme ses instances ?

Non, c'est un service managé. Le client ne gčre pas toute la partie capacity planning. Mais en une seconde il peut provisionner un datawarehouse virtuel et accéder ŕ ses données et ŕ ses calculs sur la donnée. On gčre le provisionning, la scalabilité, l'instanciation, la maintenance et la sécurité des machines

Quels sont vos drivers business pour 2022 ?

Notre data cloud s'articule autour de 6 sujets. Ŕ commencer par le datawarehouse, puis le datalake, le data engineering, la data science, le développement d'apps orientées data, et le sujet du data sharing avec la data marketplace. Il n'y a pas de sujet prioritaire, les cas d'usage sont multiples et variés. Des clients commencent un projet de migration avec un datawarehouse cloud et assez vite ils se rendent compte qu'il peuvent travailler sur des sujets de campagnes marketing pour exposer et partager des données de façon plus naturelle avec leurs fournisseurs. Ou encore déployé des capteurs IoT en allant sur des modčles prédictifs sur la chaine de production.. la priorité c'est de révéler tous les usages dont les clients nous parlent.

Quelles sont les grandes tendances du moment en termes de cas d'usage ?

L'une des tendances que l'on peut souligner vient du manufactiring. Total Energies et Michelin en sont de bons exemples avec pour ce dernier un bon sujet sur les pneus connectés. Un autre bel exemple qui a permis de trouver de la souplesse et de la flexibilité est dans le voyage et l'hôtellerie touristique. On a énormément aussi de clients dans le retail, l'assurance mutualiste aussi. Notre proposition de valeur c'est aussi un sujet de gouvernance qui est central avec des avancées trčs importantes.

Comment appréhendez-vous la notion de gouvernance de la donnée ?

Notre point de vue et partagé avec le client est d'abord le sujet de la localisation des données, ensuite celui de la gouvernance, de la sécurité et de la réversibilité. Notre couche logicielle permet de garantir l'endroit oů l'on stocke les données, ŕ Francfort, Dublin ou ailleurs. En France c'est prévu, on y réfléchit. On a commencé avec un datacenter chez AWS, aujourd'hui on est ŕ 18 et l'idée d'avoir le plus de noeuds possible. Sur la gouvernance on veut un data lineage de l'ingestion jusqu'ŕ la sortie de la donnée. Concernant la sécurité, on a tout réécrit de zéro avec un protocole de sécurité natif a la plateforme avec un chiffrement de A ŕ Z oů les clients sont les seuls propriétaires de la clé. Et côté réversibilité, si on veut revenir en arričre on reste sur des langages SQL normés et c'est garanti dans notre plateforme.

Quels exemples clients ont mis ŕ profit cette ouverture intégrée a leur projet data driven ?

On a un positionnement agnostique sur le cloud public. Aprčs avoir créé de grands silos applicatifs avec SAP et Oracle entre autres, on est entrain de recréer de grands silos cloud avec AWS, Azure, Google... C'est que l'on veut c'est adresser tous les clients quel que soit leur cloud pour les aider ŕ partager entre ces fournisseurs leurs données et les échanger sans avoir ŕ créer de la tuyauterie, des API, des transferts FTP, etc. qui sont des processus forts désagréables.

Quel est votre principal moteur de développement et comment la France y contribue ?

Snowflake a un développement trčs global. On a déplacé le sičge ŕ Bozeman dans le Montana au lieu de la Californie pour montrer que l'on va partout dans le monde, et que l'on ne s'installe pas seulement ŕ Londres ou San Francisco. Désormais nous sommes listés au NYSE. Notre plan de développement va bien au-delŕ de notre milliard de dollars de revenus actuel, mais on se projette ŕ 7-8 ans dans les 10 milliards de revenus. La France représente une part non négligeable de notre ambition avec l'Angleterre et l'Allemagne en Europe. On ouvre aussi d'autres marchés et nous avons révolutionné le modčle d'engagement client et notre modčle de rétribution de nos collaborateurs sur le terrain, mesurée et appréciée sur la performance de succčs client.

Quel visage aura Snowflake France en 2022 ?

Je ne peux pas communiquer en termes d'effectifs ni de chiffre d'affaires. En termes d'axe pivot, on va avoir des équipes orientées domaines clients. Nous voulons des équipes commerciales et ingénieurs avant ventes trčs en maitrise du contexte d'activité. Cette verticalité est trčs importante pour adresser la richesse des opportunités, ce n'était pas le cas jusqu'ŕ présent. Il faut aussi une certaine mise ŕ l'échelle sur nos 13 secteurs d'activité et sur toutes les tailles de marchés. On va accélérer aussi l'animation partenaire avec les intégrateurs systčmes globaux et nos alliances technologiques, et aussi accompagner nos clients et les rassurer sur notre capacité d'exécution, continuer ŕ former et aller jusqu'ŕ la certification.

Comment facilitez-vous l'intégration de votre solution sur des projets de grande ampleur touchant au coeur des données des entreprises sur lesquels la facturation peut devenir vote exorbitante ?

On n'a pas la sensation d'avoir besoin d'optimiser la plateforme pour ętre simple a implémenter. Elle ne souffre pas de legacy qui l'encombre. Le time to market est trčs rapide, le ROI numéro un que les clients voient est sur la simplicité de mise en action et en production de leur premier cas d'usage. On a été un des premiers acteurs ŕ proposer un modčle de consommation utilitaire : on facture sur le niveau de compute ŕ la seconde ; quand les requętes ne passent pas, il n'y a pas de facturation. Côté stockage,on ne fait pas de marge, car on réplique le coűt qu'AWS nous charge. La monétisation va se faire sur le compute, les requętes et traitements sur ces données. Il n'y a pas de coűts cachés.

Suivez-nous